刚刚畴昔的 2024 年是生成式 AI 大发展的一年,咱们见证了 OpenAI Sora 的崛起韩国伦理片,大模子办事价钱的赶快下落,以及国内开源大模子的力争上游。这全标的的快速发展让咱们对下一波 AI 的新时刻大范围应用充满了信心。

对于身在 AI 领域的工程师和学者们来说,他们看待这一年的不雅点会有不同吗?

新年开端,就有东谈主对畴昔一年里大模子时刻的发展进行了详备的总结。本文的作家 Simon Willison 是英国知名颓落研究员和怒放源代码创建者。

让咱们望望他是怎么说的。

2024 年,大型语言模子领域发生了许多事情。以下是畴昔 12 个月咱们对该领域的研究后果的回想,以及我尝试详情的要害主题和要害时刻。

2023 年的总结在这里:https://simonwillison.net/2023/Dec/31/ai-in-2023/

在 2024 年,咱们不错看到:

GPT-4 独揽被全面摧毁

一些 GPT-4 级模子不错在条记本电脑上运行

由于竞争和优化,大模子办事的价钱崩盘

多模态视觉一经变得常见,音频和视频模子启动出现

语音和及时录像头模式正从科幻演义变成现实

一个请示词作念出一个 APP,一经很广宽了

对最好模子的广宽拜谒仅持续了短短几个月

AI 「智能体」可能还有点远

评估真的很紧迫

Apple Intelligence 很灾祸,但 MLX 库很出色

正在崛起的「推理」模子

目前最好的 LLM 来自中国,西宾本钱不到 600 万好意思元?

环境影响变好了,但也在变得越来越严重

合成西宾数据效果很好

LLM 不知缘何变得更难用了

常识散布不均匀

LLM 需要更好的月旦

GPT-4 独揽被全面摧毁

在 2023 年 12 月的驳倒中,我写了对于咱们还不知谈如何构建 GPT-4——OpenAI 提倡的最初大模子其时一经有近一年的历史了,但莫得其他东谈主工智能实验室能作念出更好的模子。OpenAI 的作念法内部有什么过东谈主之处吗?

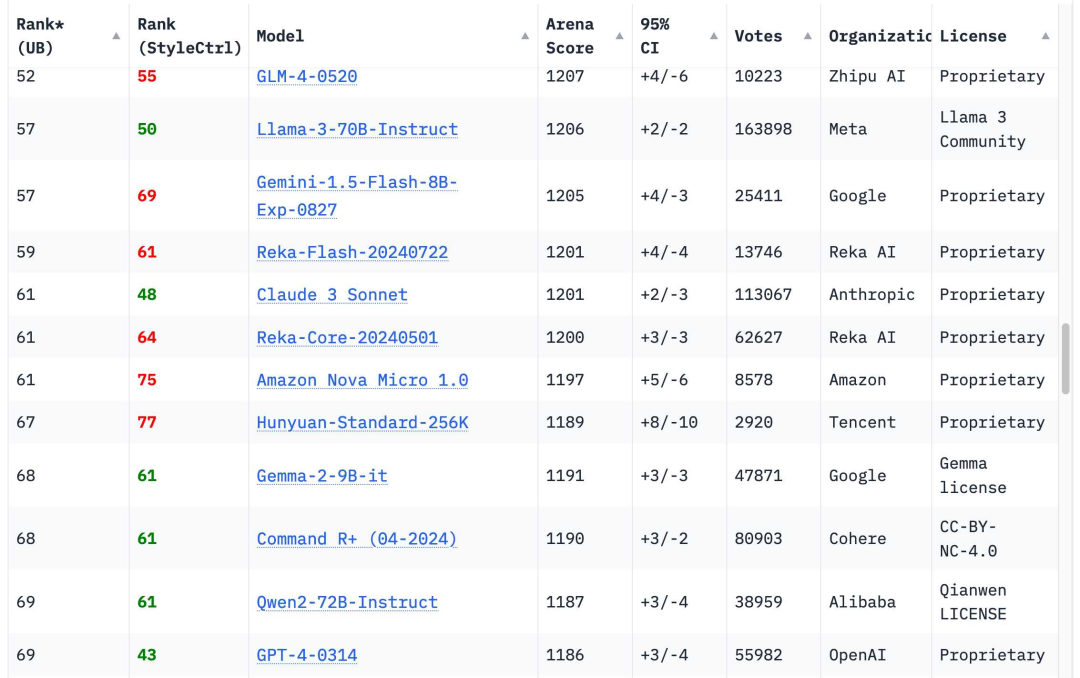

令东谈主喜跃的是,这种情况在畴昔十二个月里完全改变了。当今有 18 个公司、机构在 Chatbot Arena 排名榜上的模子排名高于 2023 年 3 月的原始 GPT-4(排名榜上的 GPT-4-0314)—— 所有有 70 个模子。

其中最早的是谷歌于 2 月发布的 Gemini 1.5 Pro。除了产生 GPT-4 级别的输出外,它还为该领域引入了几项全新的功能 —— 最值得珍爱的是其 100 万(自后是 200 万)个 token 输入高下文长度,以及接收视频的技艺。

我其时在《The killer app of Gemini Pro 1.5 is video》中写到了这少许,这让我在 5 月的谷歌 I/O 开幕主题演讲中当作主办东谈主一刹出面。

Gemini 1.5 Pro 还展示了 2024 年的一个要害主题:增多高下文长度。客岁,大多数模子接收 4096 或 8192 个 token,但 Claude 2.1 是个值得珍爱的例外,它能接收 20 万个 token。如今,每个严肃的提供商皆有一个 10 万以上的 token 模子,而谷歌的 Gemini 系列最多不错剿袭 200 万个 token。

更长的输入极地面增多了使用 LLM 不错解决的问题范围:你当今不错插足一整本书并接头联系其内容的问题。但更紧迫的是,你不错输入多量示例代码来匡助模子正确解决编码问题。波及长输入的 LLM 用例对我来说比地谈依赖模子权重中一经镶嵌的信息的短请示更兴味兴味。我的许多器具皆是使用这种模式构建的。

回到打败 GPT-4 的模子:Anthropic 的 Claude 3 系列于 3 月推出,Claude 3 Opus 很快成为我最可爱的日常大模子。他们在 6 月进一步提高了赌注,推出了 Claude 3.5 Sonnet—— 六个月后,这个模子仍然是我的最爱(尽管它在 10 月 22 日进行了要紧升级,令东谈主困惑的是保留了同样的 3.5 版块号。Anthropic 粉丝从那时起就可爱称它为 Claude 3.6)。

然后是其余的大模子。要是你今天浏览 Chatbot Arena 排名榜(仍然是获取基于情谊的模子评估的最有用的场地),你会发现 GPT-4-0314 一经跌至第 70 位傍边。领有得分较高的模子的 18 家组织分别是 Google、OpenAI、阿里、Anthropic、Meta、Reka AI、01 AI、亚马逊、Cohere、DeepSeek、英伟达、Mistral、NexusFlow、Zhipu AI、xAI、AI21 Labs、普林斯顿和腾讯。

一些 GPT-4 级模子不错在条记本电脑上运行

我的个东谈主条记本电脑是 2023 年的 64GB M2 MacBook Pro。这是一台功能刚烈的机器,但它也一经有近两年的历史了 —— 何况至关紧迫的是,我自 2023 年 3 月第一次在电脑腹地上运行 LLM 以来,一直在使用的是归拢台条记本电脑。

客岁 3 月,归拢台条记本电脑险些不错运行 GPT-3 类模子,当今一经运行了多个 GPT-4 类模子!我对此的一些谛视:

Qwen2.5-Coder-32B 是一款不错很好地编码的 LLM,可在我的 Mac 上运行,11 月份韩国伦理片,我谈到了 Qwen2.5-Coder-32B——Apache 2.0 许可模子。

我当今不错在我的条记本电脑上运行 GPT-4 类模子,运行 Meta 的 Llama 3.3 70B(12 月发布)。

这对我来说仍然很令东谈主诧异。咱们蓝本会想天然地认为具有 GPT-4 功能和输出质地的模子需要一台数据中心级办事器,该办事器具有一个或多个价值 4 万好意思元以上的 GPU。

事实上,这些模子占用了我 64GB 的内存空间,是以我时通常运行它们 —— 运行的时候就不颖异其他的事了。

它们或者运行的事实评释注解了 AI 领域在畴昔一年中取得了令东谈主难以置信的西宾和推感性能普及。事实评释注解,在模子效率方面,还有许多随手可取的后果。我瞻望将来还会有更多。

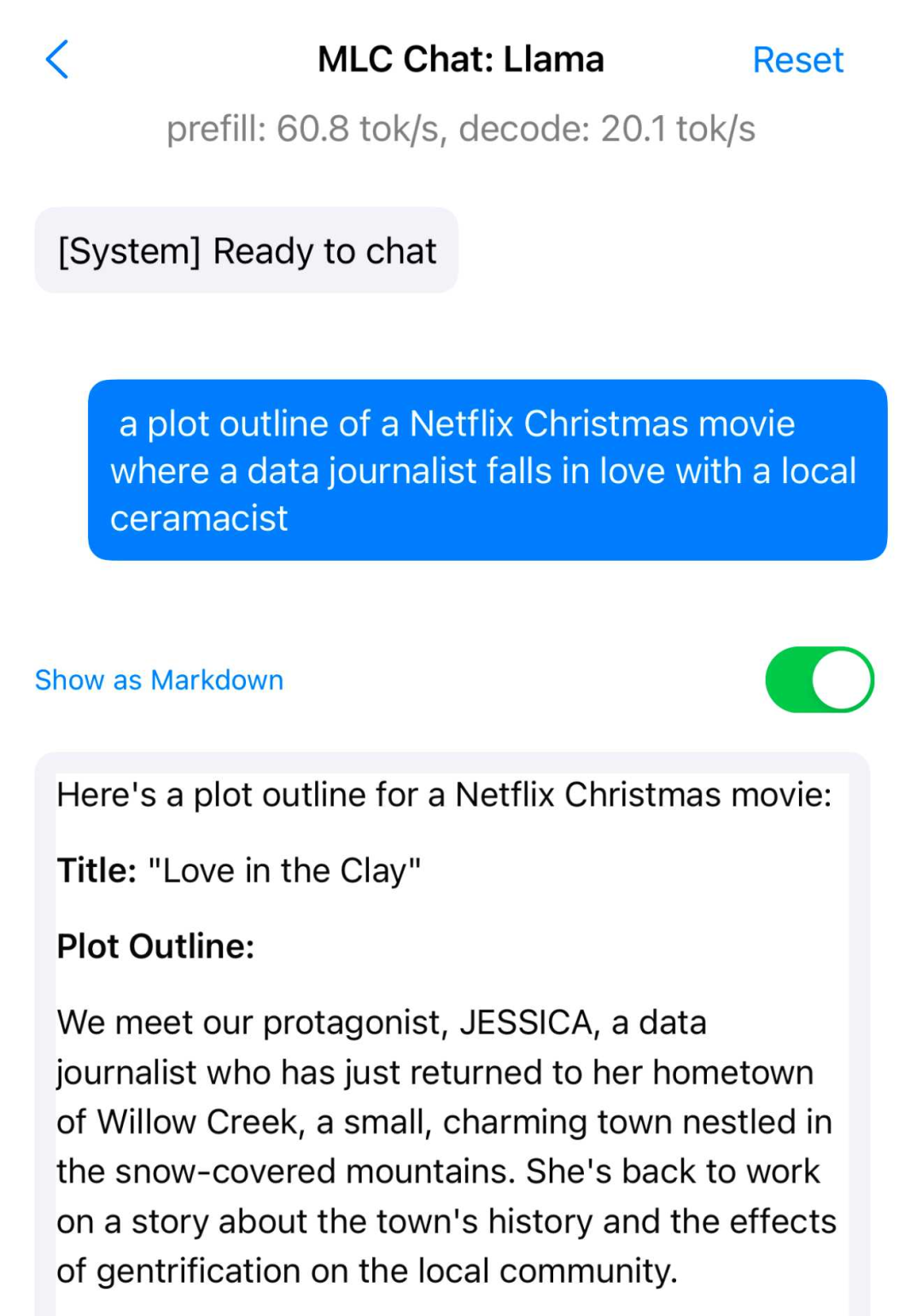

Meta 的 Llama 3.2 模子值得特地说起。它们可能不是 GPT-4 级别,但在 1B 和 3B 大小下,它们的性能远远超出了参数目的水平。我使用免费的 MLC Chat iOS 应用程序在 iPhone 上运行 Llama 3.2 3B,对于其眇小(<2GB)的参数目来说,这是一个功能惊东谈主的模子。尝试启动它并条款它提供「Netflix 圣诞电影的情节大纲,其中一位数据记者爱上了一位当地的陶瓷师」。这是我得到的闭幕,每秒 20 个 token 的速率特地可不雅:

它平凡而普通,但我的手机当今不错向 Netflix 推选平凡而普通的圣诞电影了!

由于竞争和优化

大模子办事的价钱崩盘

在畴昔的 12 个月中,通过顶级托管办事的 LLM 运行 token 的本钱急剧下落。

2023 年 12 月(这是 OpenAI 订价页面的互联网快照),OpenAI 对 GPT-4 收取 30 好意思元 / 百万输入 token,对其时新推出的 GPT-4 Turbo 收取 10 好意思元 /mTok,对 GPT-3.5 Turbo 收取 1 好意思元 /mTok。

今天 30 好意思元 /mTok 不错让你获取 OpenAI 最高亢的模子 o1。GPT-4o 售价 2.50 好意思元(比 GPT-4 低廉 12 倍),GPT-4o mini 售价 0.15 好意思元 /mTok—— 比 GPT-3.5 低廉近 7 倍,功能刚烈得多。

其他模子提供商的收费以致更低。Anthropic 的 Claude 3 Haiku(从 3 月启动,但仍然是他们最低廉的型号)为 0.25 好意思元 /mTok。Google 的 Gemini 1.5 Flash 为 0.075 好意思元 /mTok,而他们的 Gemini 1.5 Flash 8B 为 0.0375 好意思元 /mTok—— 比客岁的 GPT-3.5 Turbo 低廉 27 倍。

我一直在我的 llm 订价标签下追踪这些价钱变化。

这些价钱下落是由两个成分驱动的:竞争加重和效率提高。对于每个柔柔 LLM 对环境影响的东谈主来说,效率真的很紧迫。这些价钱下落与运行请示所破费的动力量径直联系。

对于大型 AI 数据中心树立对环境的影响,仍然有许多值得牵记的场地,但许多对单个请示的动力本钱的担忧已不再着实。

这里有一个兴味兴味的简便盘算:使用 Google 最低廉的型号 Gemini 1.5 Flash 8B(10 月发布)为我个东谈主像片库中的每 6.8 万张像片生成简单形色需要破耗若干钱?

每张像片需要 260 个输入 token 和梗概 100 个输出 token。

260×68,000 = 17,680,000 个输入 token

17,680,000×0.0375 好意思元 / 百万 = 0.66 好意思元

100×68,000 = 6,800,000 个输出 token

6,800,000×0.15 好意思元 / 百万 = 1.02 好意思元

处理 68,000 张图片的总本钱为 1.68 好意思元。这太低廉了,我不得不盘算了三次才能阐发我作念对了。

这些形色有多好意思好?这是我从一滑敕令中得到的闭幕:

llm -m gemini-1.5-flash-8b-latest describe -a IMG_1825.jpeg

处理在加州科学院照的这张蝴蝶像片:

输出内容:

一个浅盘,可能是蜂鸟或蝴蝶喂食器,是红色的。盘内可见橙色生果片。喂食器中有两只蝴蝶,一只深棕色/玄色蝴蝶,带有白色/奶油色花纹。另一只大号棕色蝴蝶,带有浅棕色、米色和玄色花纹,包括显豁的眼斑。较大的棕色蝴蝶似乎正在吃生果。

260 个输入 token,92 个输出 token。本钱约为 0.0024 好意思分(不到 400 分之一好意思分)。效率的提高和价钱的缩小是我最可爱的 2024 年趋势。我但愿以极低的动力本钱获取 LLM 的效率,看起来这即是咱们得到的。

多模态视觉一经变得常见

音频和视频模子启动出现

上头的蝴蝶示例评释了 2024 年的另一个要害趋势:多模态 LLM 正在兴起。

一年前,其中最引东谈主注视的例子是 GPT-4 Vision,于 2023 年 11 月在 OpenAI 的 DevDay 上发布。谷歌的多模态 Gemini 1.0 于 2023 年 12 月 7 日发布,因此它也(刚好)进入了 2023 年的窗口。

2024 年,险些每个紧迫的模子供应商皆发布了多模态模子。咱们在 3 月看到了 Anthropic 的 Claude 3 系列,4 月看到了 Gemini 1.5 Pro(图像、音频和视频),然后 9 月各家带来了 Qwen2-VL 和 Mistral 的 Pixtral 12B 以及 Meta 的 Llama 3.2 11B 和 90B 视觉模子。

10 月份,咱们从 OpenAI 获取了音频输入和输出,11 月份,咱们从 Hugging Face 获取了 SmolVLM,12 月份,咱们从 Amazon Nova 获取了图像和视频模子。

10 月份,我也升级了我的 LLM CLI 器具,以通过附件辅助多模态模子。它当今领有一系列不同视觉模子的插件。

我认为,挟恨 LLM 阅兵速率放缓的东谈主往往忽略了这些多模态模子的巨大跳跃。或者针对图像(以及音频和视频)运行请示是一种应用这些模子的迷东谈主新措施。

语音和及时录像头模式

正从科幻演义变成现实

新兴的音频和及时视频模式值得特地关注。

与 ChatGPT 对话的功能初度出当今 2023 年 9 月,但其时还没真实兑现:OpenAI 要用旗下的 Whisper 语音转文本模子和一个新的文本转语音模子(名为:tts-1)来兑现与 ChatGPT 对话,但施行的模子还只可看到文本。

5 月 13 日,OpenAI 春季发布会推出了 GPT-4o。多模态模子 GPT-4o(o 代表「omni」,是万能的兴味)能径直「听懂」你说的每一句话 —— 剿袭音频输入并输出令东谈主难以置信的传神语音,也不再需要 TTS 或 STT 模子在其中滚动。

这个演示中的声息与斯嘉丽・约翰逊惊东谈主地相似...... 在斯嘉丽投诉之后,这个声息 Skye 从未在职何厚爱居品中亮相。

不外,发布会上阿谁让东谈主目下一亮的 GPT-4o 高等语音功能在居品端上线的权谋一再推迟,这引起了不少接洽。

当 2024 年 8 月至 9 月期间,ChatGPT 高等语音模式最终上线时,效果真的惊艳到我了。

我时常在遛狗时使用它,更拟东谈主的语调,让 AI 生成的内容听起来新活泼。锤真金不怕火 OpenAI 的音频 API 也很兴味兴味。

更兴味兴味的是:高等语音模式不错效法口音!比如,我让它「假装你是一只带着油腻俄罗斯口音的加利福尼亚棕鹈鹕,但只用西班牙语和我交谈」:

OpenAI 不是独逐个家在搞多模态音频模子的公司,Google 的 Gemini 也能接收语音输入,何况 Gemini 应用当今也能像 ChatGPT 一样语言了。亚马逊也提前文书了他们的 Amazon Nova 会有语音模式,不外得比及 2025 年第一季度才能用上。

Google 在 9 月份发布的 NotebookLM 把音频输出玩出了新花样 —— 它能生成超等传神的「播客主办东谈主」对话,不管你给它什么内容皆行。自后他们还加入了自界说指示功能,我天然二话没说就把主办东谈主皆变成了鹈鹕:

最新的转化出当今 12 月(这个月可简直骚动),即是及时视频功能。ChatGPT 的语音模式当今让你不错径直和模子分享录像头画面,及时聊聊你看到的东西。Google Gemini 也推出了雷同的预览功能,此次终于抢在 ChatGPT 前一天发布了。

这些功能才刚出来几个星期,我认为它们的影响力还没完全显现出来。要是你还没试过,真的要体验一下!

Gemini 和 OpenAI 皆提供这些功能的 API 接口。OpenAI 最启动用的是比较难搞的 WebSocket API,不外在 12 月他们推出了新的 WebRTC API,用起来简便多了。当今,要开发一个能和用户语音对话的网页应用一经变得超等容易了。

一个请示词作念出一个 APP

一经很广宽了

这在 2023 年就不错通过 GPT-4 兑现了,但直到 2024 年它的价值才真实突显。

咱们早就知谈大语言模子在写代码方面有着惊东谈主的技艺。要是你给出适合的请示词,它们能用 HTML、CSS 和 JavaScript(要是树立好联系环境,还能用上 React 这样的器具)为你构建一个完整的交互式应用程序 —— 往往只需要一个请示词就够了。

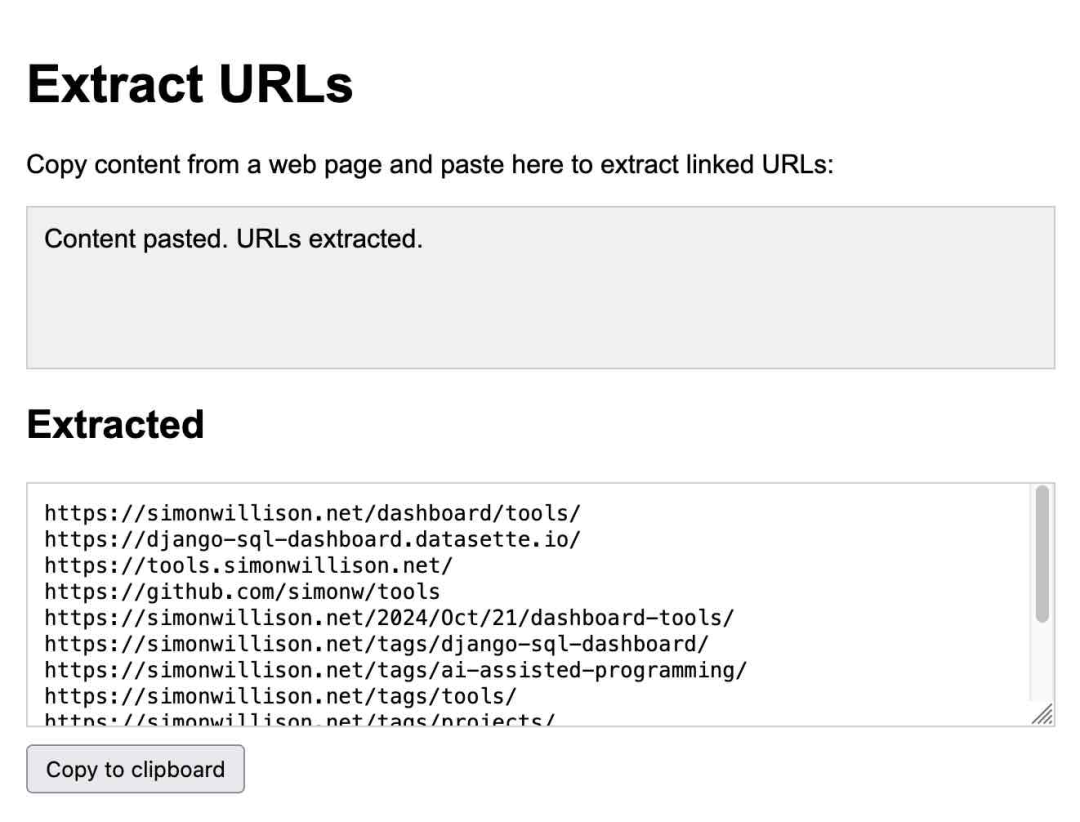

Anthropic 在发布 Claude 3.5 Sonnet 的公告中,顺带先容了一个突破性的新功能:Claude Artifacts。这个功能开端并莫得引起太大关注,因为它仅仅在公告中写了一下。

有了 Artifacts,Claude 不错为你写一个即时交互式应用,然后让你径直在 Claude 界面中使用它。

这即是我用 Claude 生成的一个提真金不怕火网页 URL 的应用:

当今 Claude Artifacts 一经成为了我的依靠。许多其他团队也开发了雷同的系统,举例,GitHub 在 10 月份推出了他们的版块:GitHub Spark。Mistral Chat 在 11 月份添加了一个叫 Canvas 的雷同功能。

来自 Val Town 的 Steve Krause 基于 Cerebras 构建了一个版块,展示了一个每秒处理 2000 个 token 的大语言模子如何能在不到一秒的时刻内对应用进行迭代更新。

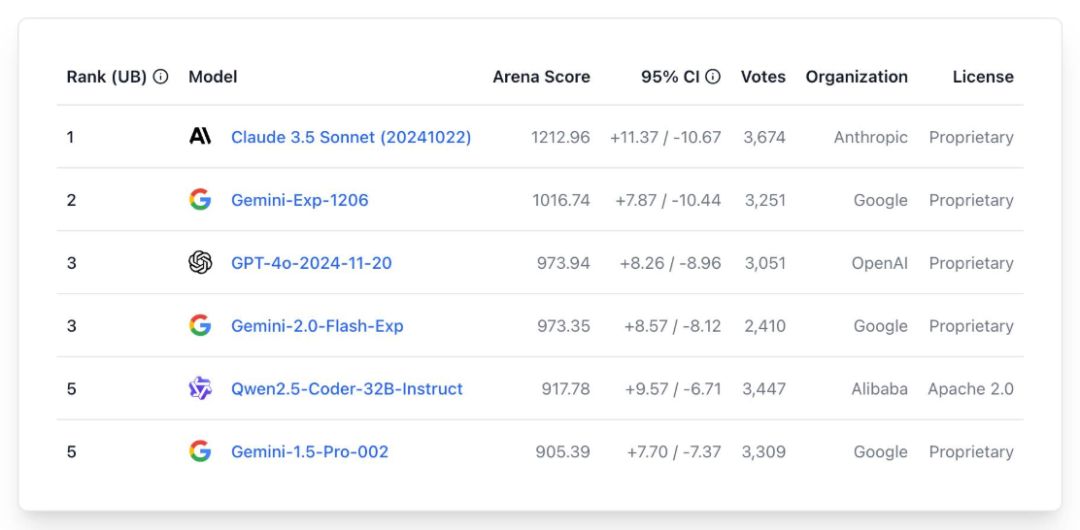

到了 12 月,Chatbot Arena 团队为此类功能推出了一个全新的排名榜,用户不错用两个不同的模子构建同样的交互式应用,然后对闭幕进行投票。

排名榜前六位

很难找到比这更有劝服力的字据,这项功能当今一经成为能在系数主流模子上灵验兑现的通用功能了。

我我方也在为 Datasette 项目开发雷同的功能,办法是让用户或者通过请示来构建和迭代针对我方数据的自界说小部件和数据可视化。我还通过 uv 找到了一种编写一次性 Python 程序的雷同模式。

这种请示驱动的自界说界面功能相等刚烈,何况构建起来也很容易(唯独你措置了浏览器沙箱的那些辣手细节),我瞻望在 2025 年会有一大波居品皆会推出雷同功能。

对最好模子的广宽拜谒仅持续了短短几个月

本年有几个月的时刻,三个最好的可用模子:GPT-4o、Claude 3.5 Sonnet 和 Gemini 1.5 Pro,皆不错被全国上大多数东谈主免费使用。

OpenAI 在 5 月份向系数用户怒放了 GPT-4o 的免费使用权限,而 Claude 3.5 Sonnet 从 6 月份发布起即是免费的。

这是一个要紧的改变,因为在之前的一年里,免用度户主要只可使用 GPT-3.5 级别的模子,这导致新用户对大语言模子的施行技艺形成了很不准确的相识。

不外,这个期间似乎一经闭幕了,何况很可能是始终性的,标记是 OpenAI 推出了 ChatGPT Pro。这项每月 200 好意思元的订阅办事是拜谒他们最刚烈的新模子(o1 Pro)的独一路子。

由于 o1 系列(以及「o 系列」将来的模子)背后的决窍是插足更多的盘算时刻来获取更好的闭幕,我认为那些能免费就能拜谒到最顶级的模子的日子,应该不会再回来了。

AI 「智能体」可能还有点远

说真话,AI Agents 这个词让我很头疼。它莫得一个颐养、澄澈且被肤浅招供的界说。更糟的是,用这个词的东谈主似乎从来不承认这少许。

要是你告诉我你在开发 AI Agents,这基本上等于什么皆没说。除非我能读心,不然我根柢不知谈,AI Agents 界说有几十种,你到底在造哪一种?

我看到的 AI Agents 开发者主要有两类:一类认为 AI Agents 昭彰即是替你作念事的东西,就像旅行社那样;另一类东谈主则在想象为大语言模子配备各式器具,让大模子或者自主驱动,实行任务。

东谈主们还时常提到「autonomy」这个词,但同样也没评释晰是什么兴味。

(几个月前我在推特上采集了 211 个界说,我还让 gemini-exp-1206 试着总结了一下这些界说。)

文档相接:https://lite.datasette.io/?json=https://gist.github.com/simonw/bdc7b894eedcfd54f0a2422ea8feaa80#/data/raw

不管这个词到底是什么兴味,AI Agents 总会给东谈主一种「行将成真」的嗅觉。

撇开术语不谈,我对它们的实用性持怀疑作风,原因如故一个老问题:大语言模子很容易「轻信」,它会照单全收你告诉它的一切。

这就暴自满一个要害问题:要是一个有谋略辅助系统连真假皆分不清,它还能推崇多大作用?岂论是旅行参谋人、生存助手,如故研究器具,皆会因为这个颓势而大打扣头。

最近就有一个现成的例子:就在前几天,谷歌搜索闹了个大乌龙。它把粉丝创作网站上一个假造的《魔法满屋 2》剧情,当成了真实电影来先容。

请示注入即是这种「轻信」的势必闭幕。自 2022 年 9 月以来咱们一直在接洽这个问题,但 2024 年在解决这个问题上,险些莫得什么进展。

我启动认为,最流行的 AI Agents 意见其实依赖于通用东谈主工智能的兑现。要让一个模子或者屈膝「轻信」,这简直个勤恳的任务。

评估真的很紧迫

Anthropic 的 Amanda Askell(负责 Claude 特性塑造的主要使命者)说:

系统请示背后阿谁败兴但至关紧迫的私密即是用测试驱动开发。你不是先写一个系统请示,然后再想办法测试它,而是先写好测试,然后找到一个能通过这些测试的系统请示。

2024 年的资格告诉咱们:在大语言模子应用领域,最紧迫的中枢竞争力是什么?是一套完善的自动化评估系统。

为什么这样说?因为有了它,你就能:霸占先机,快东谈主一步领受新模子,加快迭代,约束优化居品,确保功能既可靠又实用。

Vercel 的 Malte Ubl 说:

当 @v0 刚推出时,咱们相等牵记要用各式预处理和后处理的复杂操作来保护请示。

于是咱们透顶蜕变念念路,给了它充分的推崇空间。但很快就发现:莫得评估程序、莫得模子带领、更莫得用户体验的请示,就像拿到一台没评释书的 ASML 机器 —— 就算再先进,也无从下手。

我还在探索最合适我方的使命模式。评估的紧迫性已是共鸣,但「如何作念好评估」这个问题却仍然穷乏系统性的带领。我一直在通过评估标签追踪这方面的进展。我当今用的「鹈鹕骑自行车」SVG 基准测试,与那些训练的评估套件比拟,还有很长的路要走。

Apple Intelligence 很灾祸

但 MLX 库很出色

客岁,因为莫得配备 NVIDIA GPU 的 Linux/Windows 机器,我在尝试新模子的时候遭受了不少防碍。

从树立上看,64GB 的 Mac 本应该是运行 AI 模子的梦想之选 —— CPU 和 GPU 分享内存的遐想号称好意思满。

但现实很霸道:当下的 AI 模子在发布时,基本皆是以模子权重和开发库的体式推出,而这些险些只适配 NVIDIA 的 CUDA 平台。

llama.cpp 生态系统在这方面帮了大忙,但真实的突破是苹果的 MLX 库,这是一个「专为 Apple Silicon 遐想的数组框架」。它真的很棒。

苹果的 mlx-lm Python 辅助在我的 Mac 上运行各式 MLX 兼容的模子,性能相等出色。Hugging Face 上的 mlx-community 提供了高出 1000 个已调养为必要形态的模子。

Prince Canuma 开发的优秀且发展迅速的 mlx-vlm 项目也把视觉大语言模子带到了 Apple Silicon 上。我最近用它运行了 Qwen 的 QvQ。

固然 MLX 是个改变游戏国法的东西,但苹果我方的 Apple Intelligence 功能大多令东谈主失望。我本来相等期待 Apple Intelligence,在我的预测中,我认为苹果绘专注于作念能保护用户苦衷,打造让用户澄澈明了、不会污蔑的大语言模子应用。

当今这些功能一经推出,效果特地差。当作一个大语言模子的重度用户,我知谈这些模子能作念什么,而苹果的大语言模子功能仅仅提供了一个煞白的效法。咱们得到的辱骂解新闻标题的见告概要,以及完全没用的写稿助手器具,不外 emoji 生成器如故挺挑升念念的。

正在崛起的「推理」模子

2024 年临了一个季度最兴味兴味的进展是一种新式 LLM 的出现,以 OpenAI 的 o1 模子为代表。

要贯串这些模子,不错把它们看作是「念念维链请示」技巧的蔓延。这个技巧最早出当今 2022 年 5 月的论文《Large Language Models are Zero-Shot Reasoners》中。

这个技巧主要在说,要是你让模子在解决问题时「高声念念考」,它往往能得到一些蓝本想不到的闭幕。

o1 把这个进程进一步融入到了模子本人。具体细节有点污秽:o1 模子会破耗一些「推理 token」来念念考问题(用户看不到这个进程,不外 ChatGPT 界面会自满一个总结),然后给出最终谜底。

这里最大的革命在于,它始创了一种新的扩张模子的方式:不只纯地通过增多西宾时的盘算量来普及模子性能,而是让模子在推理时插足更多盘算资源来解决更难的问题。

o1 的续作 o3 在 12 月 20 日发布,o3 在 ARC-AGI 基准测试上取得了惊东谈主得益。不外,从 o3 的无数推理本钱来看,它可能花掉了高出 100 万好意思元的盘算本钱!

o3 瞻望将在 1 月份推出。但我认为很少有东谈主的施行问题需要这样大的盘算支出,o3 也标记着 LLM 架构在处理复杂问题时迈出了本色性的一步。

OpenAI 并不是这个领域的「独角戏」。谷歌在 12 月 19 日也推出了他们的第一个雷同居品:gemini-2.0-flash-thinking-exp。

阿里巴巴的 Qwen 团队在 11 月 28 日发布了他们的 QwQ 模子,我在我方电脑上就能跑。他们在 12 月 24 日又推出了一个叫 QvQ 的视觉推理模子,我也在腹地运行过。

DeepSeek 在 11 月 20 日通过他们的聊天界面提供了 DeepSeek-R1-Lite-Preview 模子试用。

要深入了解推理扩张,我推选望望 Arvind Narayanan 和 Sayash Kapoor 写的《Is AI progress slowing down?》这篇著述。

Anthropic 和 Meta 还没什么动静,不外我赌他们坚信也在开发我方的推理扩张模子。Meta 在 12 月发表了一篇联系论文《Training Large Language Models to Reason in a Continuous Latent Space》。

目前最好的 LLM 来自中国

西宾本钱不到 600 万好意思元?

不完全是,但差未几是。这的确是个吸引眼球的好标题。

本年年底的大新闻是 DeepSeek v3 的发布,它在圣诞节本日连 README 文献皆莫得就被放到了 Hugging Face 上,第二天就发布了文档和论文。

DeepSeek v3 是一个刚烈的 685B 参数模子,是目前最大的公开授权模子之一,比 Meta 公司最大的 Llama 系列模子 Llama 3.1 405B 还要大得多。

基准测试闭幕标明,它与 Claude 3.5 Sonnet 不相高下。Vibe 基准测试(又称聊天机器东谈主竞技场)目前将其排在第 7 位,仅次于 Gemini 2.0 和 OpenAI 4o/o1 型号。这是迄今为止排名最高的公开授权模子。

DeepSeek v3 真实令东谈主印象深远的是其西宾本钱。该模子在 2,788,000 个 H800 GPU 时内完成了西宾,揣摸本钱为 5,576,000 好意思元。Llama 3.1 405B 西宾了 30,840,000 个 GPU 小时,是 DeepSeek v3 的 11 倍,但模子的基准性能却稍逊一筹。

好意思国对中国出口 GPU 的规章似乎激励了一些相等灵验的西宾优化。

环境影响得到改善

模子(包括托管模子和我不错在腹地运行的模子)效率的提高带来了一个可喜的闭幕,那即是在畴昔几年中,运行 Prompt 的能耗和对环境的影响大大缩小了。

与 GPT-3 期间比拟,OpenAI 我方的请示词器收费也缩小了 100 倍。我有可靠音问称,Google Gemini 和 Amazon Nova(两家最低廉的模子提供商)皆莫得蚀本运行请示词器。

我认为这意味着,当作个东谈主用户,咱们完全毋庸为绝大多数请示词破费的动力感到内疚。与在街上开车,以致在 YouTube 上看视频比拟,其影响可能聊胜于无。

同样,西宾亦然如斯。DeepSeek v3 的西宾用度不到 600 万好意思元,这是一个相等好的迹象,标明西宾本钱不错何况应该不绝下落。

对于效率较低的模子,我认为将其动力使用量与贸易航班进行比较口角常有用的。最大的 Llama 3 模子的本钱约等于从纽约到伦敦的一位数满载乘客航班。这天然不是一无是处,但一朝经过西宾,该模子就不错供数百万东谈主使用,而无需额外的西宾本钱。

环境影响也变得越来越严重

更大的问题在于,将来这些模式所需的基础设施树立将濒临巨大的竞争压力。

谷歌、Meta、微软和亚马逊等公司皆在斥资数十亿好意思元树立新的数据中心,这对电网和环境变成了巨大影响。以致还有东谈主说要建立新的核电站,但这需要几十年的时刻。

这些基础设施有必要吗?DeepSeek v3 的 600 万好意思元西宾本钱和 LLM 价钱的持续暴跌可能默示了这少许。关联词,你是否但愿我方成为别称大型科技公司的高管,在几年后评释注解我方的不雅点是异常的情况下,仍然对持不树立这些基础设施呢?

一个兴味兴味的比较点是,19 世纪铁路辞全国各地的铺设方式。修建这些铁路需要无数投资,并对环境变成巨大影响,何况修建的许多默契被评释注解是毋庸要的,无意不同公司的多条默契办事于完全同样的道路。

由此产生的泡沫导致了数次金融崩溃,参见维基百科中的 1873 年焦灼、1893 年焦灼、1901 年焦灼和英国的铁路狂热。它们给咱们留住了多量有用的基础设施,也变成了多量收歇和环境碎裂。

「泔水」之年

2024 年是「泔水」一词成为艺术术语的一年。我在 5 月份写过一篇著述,对 @deepfates 的这条推文进行了扩张:

及时不雅察「泔水」如何成为一个艺术术语。就像「垃圾邮件」成为不受接待电子邮件的独著名词一样,「泔水」也将当作东谈主工智能生成的不受接待内容的独著名词被载入字典。

我把这个界说稍稍扩张了一下:

「泔水」指的是东谈主工智能生成的未经请乞降审查的内容。

临了,《卫报》和《纽约时报》皆援用了我对于泔水的讲述。

以下是我在《纽约时报》上说的话:

社会需要字斟句酌的方式来辩论当代东谈主工智能,岂论是正面的如故负面的。「忽略那封邮件,它是垃圾邮件 」和「忽略那篇著述,它是泔水」皆是有用的教授。

我可爱「泔水」这个词,因为它字斟句酌地玄虚了咱们不应该使用生成式 AI 的一种方式。

「泔水」以致还入选了 2024 年牛津年度词汇,但最终输给了「脑腐」。

合成西宾数据很灵验

「模子崩溃」的意见,似乎出东谈主预目力在公众相识中树大根深。2023 年 5 月,《The Curse of Recursion: Training on Generated Data Makes Models Forget》一文初度形色了这一时事。2024 年 7 月,《天然》杂志以更瞩办法标题相通了这一时事:在递归生成的数据上进行西宾时,东谈主工智能模子会崩溃。

这个想法很有眩惑力:跟着东谈主工智能生成的「泔水」充斥互联网,模子本人也会退化,将以一种导致其不可幸免堕落的方式给与我方的输出。

这昭彰莫得发生。相背,咱们看到东谈主工智能实验室越来越多地在合成内容上进行西宾 — 有相识地创建东谈主工数据,以匡助调换他们的模子走向正确的谈路。

我所见过的对此最好的形色之一来自 Phi-4 时刻回报,其中包括以下内容:

合成数据当作预西宾的紧迫构成部分正变得越来越广宽,Phi 系列模子也一直强调合成数据的紧迫性。与其说合成数据是有机数据的低价替代品,不如说合成数据与有机数据比拟有几个径直上风。

结构化学习和缓缓学习。在有机数据围聚,token 之间的关系来往回杂而障碍。可能需要许多推理技艺才能将现时象征与下一个 token 连接起来,这使得模子很难灵验地学习下一个 token 的预测。比拟之下,语言模子生成的每个 token 顾名念念义皆是由前边的象征预测的,这使得模子更容易解雇由此产生的推理模式。

另一种常见的时刻是使用较大的模子为较小、较低廉的模子创建西宾数据,越来越多的实验室皆在使用这种技巧。DeepSeek v3 使用了 DeepSeek-R1 创建的「推理」数据。Meta 的 Llama 3.3 70B 微调使用了高出 2500 万个合成生成的示例。

经心遐想进入 LLM 的西宾数据似乎是创建这些模子的要害所在。从集中上持取整个数据并不加辞别地将其插足西宾运行的期间一经室迩人远了。

LLM 不知缘何变得更难用了

我一直在强调,LLM 是刚烈的用户器具,它们是伪装成菜刀的电锯。它们看起来简便易用,给聊天机器东谈主输入信息能有多难?但施行上,要充分诈欺它们并幸免它们的许多罗网,你需要有深厚的贯串力和丰富的资格。

要是说在 2024 年,这个问题变得愈加严重的话,好音问是咱们一经建立了不错用东谈主类语言与之对话的盘算机系统,它们会修起你的问题,何况往往皆能答对。这取决于问题的内容、发问的方式,以及问题是否准确地反应在未纪录的私密西宾围聚。

可用系统的数目激增。不同的系统有不同的器具,它们不错用来解决你的问题,比如 Python、JavaScript、集中搜索、图像生成,以致数据库查询。是以你最好了解这些器具是什么,它们能作念什么,以及如何判断 LLM 是否使用了它们。

你知谈 ChatGPT 当今有两种完全不同的 Python 运行方式吗?

想要构建一个与外部 API 对话的 Claude 工件?你最好先了解一下 CSP 和 CORS HTTP 标头。

模子可能变得更刚烈了,但大多数截至却莫得改变。OpenAI 的 o1 也许终于能大部分盘算「Strawberry」中的 R,但它的技艺仍然受限于其当作 LLM 的性质,以及它所运行的线束对它的截至。O1 不行进行集中搜索,也不行使用 Code Interpreter,但 GPT-4o 却不错 —— 两者皆在归拢个 ChatGPT UI 中。(要是你条款,o1 会假装作念这些事,这是 2023 岁首 URL 幻觉 bug 的回想)。

咱们对此有何对策?险些莫得。

大多数用户皆被扔进了深水区。默许的 LLM 聊天 UI 就像是把全新的电脑用户扔进 Linux 结尾,然后指望他们我方能措置一切。

与此同期,结尾用户对这些开辟的使命旨趣和功能所形成的不准确的姿色模子也越来越常见。我见过许多这样的例子:有东谈主试图用 ChatGPT 的截图来赢得争论 — 这本来即是一个好笑的命题,因为这些模子本来就不可靠,再加上唯独你正确请示,就能让它们说任何话。

这也有一个反面:许多博物多闻的东谈主一经完全毁灭了 LLM,因为他们不解白怎么会有东谈主能从一个有如斯多颓势的器具中获益。要想最大贬抑地诈欺 LLM,要害在于学会如何使用这种既不可靠又刚烈无比的时刻。这是一项全皆不了然于目的手段!

在这里,有用的造就内容锦绣前景,但咱们需要作念得更好,而不是将其整个外包给那些在推特上狂轰滥炸的东谈主工智能骗子。

常识散布不均匀

当今,大多数东谈主皆神话过 ChatGPT。有若干东谈主神话过 Claude?

积极关注这些内容的东谈主与 99% 不关注这些内容的东谈主之间存在着巨大的常识范围。

变革的速率也船到抱佛脚迟。就在上个月,咱们看到及时界面的普及,你不错将手机录像头瞄准某样东西,然后用声息辩论它...... 还不错聘用让它假装成圣诞老东谈主。大多数自我认证的 nerd 以致还没试过这个。

鉴于这项时刻对社会的持续及潜在影响,我不认为这种差距的存在是健康的。我但愿看到更多的勤奋来改善这种情状。

LLM 需要更好的月旦

许多东谈主皆相等敌对这种东西。在我混迹的一些场地(Mastodon、Bluesky、Lobste.rs,以致偶尔在 Hacker News),即使提倡「LLM 很有用」,也足以引发一场大战。

我瓦解不可爱这项时刻的情理有许多:环境影响、西宾数据(穷乏)谈德、穷乏可靠性、负面应用、对东谈主们使命的潜在影响。

LLM 全皆值得月旦。咱们需要对这些问题进行接洽,找到缓解这些问题的措施,匡助东谈主们学会如何负连累地使用这些器具,使其正面应用大于负面影响。

我可爱对这些东西持怀疑作风的东谈主。两年多来,炒作的声息震耳欲聋,多量的「假冒伪劣商品」和异常信息充斥其中。许多异常的决定皆是在这种炒作的基础上作念出的。勇于月旦是一种良习。

要是咱们想让有有谋略权的东谈主在如何应用这些器具方面作念出正确的决定,咱们最先需要承认照实有好的应用,然后匡助解释如何将这些应用付诸实践,同期幸免许多非实用性的罗网。

(要是你仍然认为根柢莫得什么好的应用,那我就不知谈你为什么能读完这篇著述了!)。

我认为,告诉东谈主们整个领域皆是环境灾难性的剽窃机器,约束地胡编乱造韩国伦理片,岂论这代表了若干谈理,皆是对这些东谈主的伤害。这里有真实的价值,但兑现这种价值并不直不雅,需要带领。咱们这些了解这些东西的东谈主有连累匡助其他东谈主弄瓦解。